陆奇最新演讲称大模型下个拐点是组合:「行动」无处不在,包括自动驾驶、机器人、空间计算,如何理解该观点?

80 个回答

谢邀,昨天在深圳的会场,听完了陆奇博士的演讲。(嘿嘿,我没调休,刚好有时间去)

从我回国到现在两年半,已经听了三次陆奇博士的演讲了。虽然这次他的音量没前两次大(也可能是我来晚了坐到后排了),但这次他给我的感觉是更兴奋,金句频出,让全场鼓掌。他甚至说,这波浪潮中,将会诞生人类历史上第一个10T dollar估值的公司(FYI,谷歌目前市值1.3T)。

在这次分享会中,还得知一个小小的故事,原来他当初回国创办YC中国,是Sam Altman的主意。

关注我的都知道,过去几年,我在知乎的人工智能话题下也是活跃的答题者之一了。但是这波浪潮,我的感受和陆奇博士一样:「holy sh**,世界变化太快了,跟起来太吃力了」。

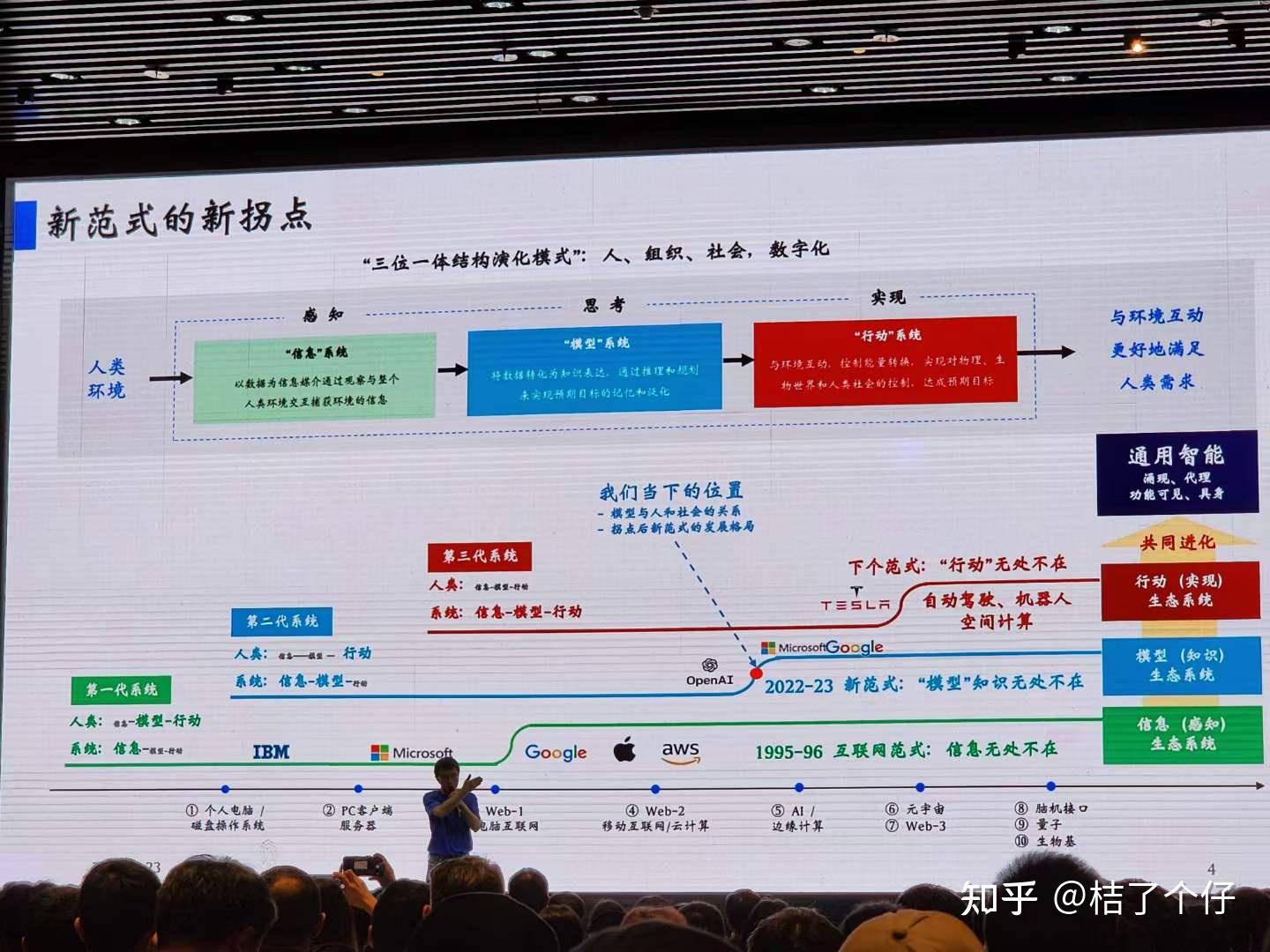

讲回陆奇博士「行动」无处不在这个观点。这是我之前没考虑过的,我认为模型压缩了这么多知识,产生了这么多涌现,已经是非常amazing了。不过他想的更超前一步,他提出了「三位一体」结构。这是现场他展示的ppt。

所谓「三位一体」,其实并不是什么高深的东西,不就是人类、组织等有机体的运作方式嘛。这里稍微结合自己的理解讲讲。

- 我们作为人,首先是感知,获得信息。

- 其次是思考。我们获得信息,就会消化信息,处理信息,从信息中获得insight,获得知识。

- 最后是行动。我们根据已有的知识,已经新获取的信息,来指导自己行动。

而这几个环节的拐点都出现在什么时候?

- 信息的拐点。也就是信息革命,我们都知道,出现在1995~1996年,互联网兴起。

- 思考的拐点。虽然大模型能否真正的「思考」还有争议,但不可否认的是,大模型能压缩海量的知识,因此现在被认为是拐点。

- 行动的拐点呢?虽然人类研发机器人,自动驾驶等技术已经很多年的历史了,甚至自动驾驶技术也可以处理很多情况,但是目前还不是基于思考的结果,而是基于计算机视觉和传感器。例如我自己的车其实也有自动辅助驾驶功能,但开起来就是没我自己开得平顺,所以我通勤路上一般不激活辅助驾驶。对此,陆奇博士说,如果自动驾驶背后是有知识的,那么对于某些复杂情况,也能举一反三。自动驾驶的那套方案可以用LLM重写一次。目前在行动方面,还没有出现和互联网革命和ChatGPT那样的「涌现时刻」,因此,他认为,下一个拐点,将发生在行动方面,而且很快就会到来(如果图中的刻度是线性的,那么我感觉他的「很快」指十年内)

他还提出,拐点的标志是「从边际成本变成固定成本」。这个如何理解呢?我提出个人看法。所谓边际成本,就是每增加一个客户,成本就要多加1份;而固定成本就是随着客户数量增加,成本不变(或变化甚微)。举个例子,在互联网出现前,我们获取信息的渠道的纸媒,多印刷一份,就需要多花一份钱;而互联网出现后,服务器成本可以看作是固定的,多一个用户,其成本的增加可以忽略不计(当然,成本还是有的,只是相对于固定成本来说,非常少)

为什么大模型也是拐点?因为大模型已经作为foundation model,它「压缩」了世界上一切知识(当然这是夸张的说法,但确实其知识量超过普通人能掌握的)。我们可以在这个foundation model之上去构建自己的应用,model training的费用是固定的了。当然model inference也是要花钱的,甚至还不少,但未来的趋势必然是infer的成本越来越低。

附: 上两次陆奇博士两次演讲内容的总结

2021:

2020:

我对于演讲里提到的“ 通用人工智能四大要素 ”很受启发,说实话第一次读这里面四个单词我有俩不知道啥意思

通用智能四大要素是:涌现(emergence)+代理(agency)+功能可见性(affordence)+具象(embodiment) 。

涌现(emergence) :这个已经在LLM展示出来。当模型大小和数据规模增加到一定程度,产生了某种复杂性突变,可以进行更高阶的推理和回答,呈现某种智能化

具象(embodiment) :这个跟embodied intelligence有关,也翻译成具身智能。也就是类似ChatGPT plugin,甚至是再去扩展,将机器人、机械臂、egocentric camera等多种和现实实体操纵感知的部件,抽象为API,供ChatGPT调用。

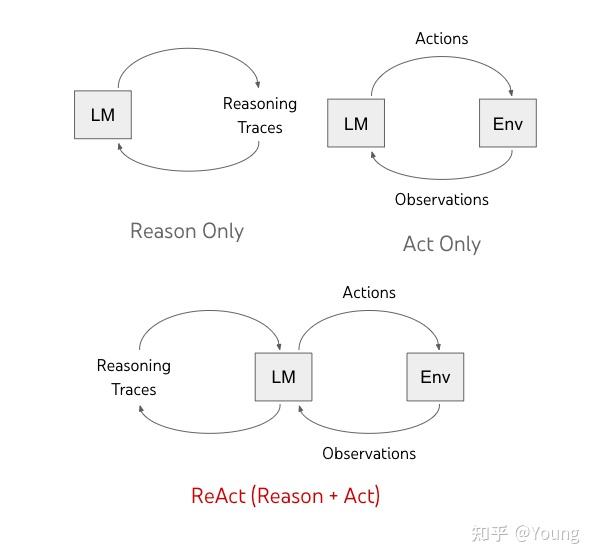

代理(agency) :这个词我目前理解的层次,是类似于目前讨论比较火的,以AutoGPT为代表,发展出的Autonomous Language Agent,即自主性语言代理。所谓自主,不同于自动(automatic),是因为额外加入了自我反思,自我规划,记忆存储等功能。可以根据笼统的大目标描述,自己分解目标,调用外部接口行动,评估结果。即thought - action - observation模式。关于这点可以详见我之前文章。

功能可见性(affordance) :一开始看原文我是没明白,特意查了一下维基百科解释

环境赋使(affordance) ,或称为 直观功能、预设用途 、 可操作暗示 、 符担性 、 支应性 、 示能性 等,指一件物品实际上用来做何用途,或被认为有什么用途。也就是说在物品的某个方面,具有让人明显知道该如何使用它的特性。例如门提供“打开”的功能,椅子提供“支撑”的功能。人们得知如何使用物品有一部分来自 认知心理学 ,另一部分来自物品的外形。

也就是一个事物可以让人知觉到可以提供的行为。这里只能说我个人的理解程度,就是类似ChatGPT的plugin,实际上是要写一段描述,来使得ChatGPT可以明白你的功能进行调用。而扩展到通用人工智能体,陆奇博士在演讲后半段也提到

我们看到的未来是更多模型的生态,新的领域、新的专业、新的结构、新的场景、新的适应能力,形成闭环,不断加强认知和推理能力。

也就是会有更多的领域特定智能(domain specific intelligent)出现,那么这些模型之间如何去交互,是不是要像plugin一样,需要自己描述出你的affordance,或者这个层面是不是需要新的protocol出现,真是让人浮想联翩。

所以下一个拐点是“组合”,但这种组合方式会非常的不同于以往软件功能的组合形式,而是非常有趣自然的一种智能体互相协作嵌合。以上只是我的一点浅见。

最后5月7日陆奇博士还会来北京进行演讲,感兴趣的朋友可以报名参加~